红旗光速量产端到端,深圳自动驾驶巨头功不可没

贾浩楠 发自 副驾寺

智能车参考 | 公众号 AI4Auto

谜底揭晓,前两天详细介绍的一汽红旗“一夜间”上车端到端,背后的核心供应商是——

卓驭。

还有一个大家更熟悉的名字:大疆车载——孵化自大疆的自动驾驶业务。

就是以“不唯传感器论”、“极致性价比”,并且最早把高速NOA普及到10万级车型而一鸣惊人的大疆。

红旗发布了什么样的智驾

前两天的红旗新能源科技日,展示了一系列关于智能、新能源的成果:

比如算芯一体的5nm芯片、,自研电芯挑战-40℃极寒启动,最高支持超千伏超充…

特别是官宣今年年底一段式端到端上车,意味着红旗将站上智能驾驶第一梯队。

转型速度之快,让人意外。

红旗智驾产品名称叫做“司南智驾”,纯视觉方案打造。

尽管纯视觉,但是能实现包括城市NOA在内的高阶智驾功能,类似小鹏前不久在P7+上量产的鹰眼智驾系统。

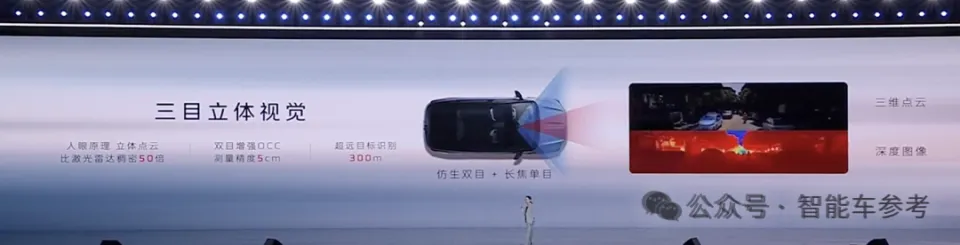

不过和小鹏在摄像头底层架构采用Lofic技术不同,司南智驾的纯视觉方案采用三目立体视觉:

基于“人眼原理”,一对仿生双目增强测量精度,一颗长焦单目可识别300米外的目标。

红旗表示,这套系统的点云密度比激光雷达更稠密。

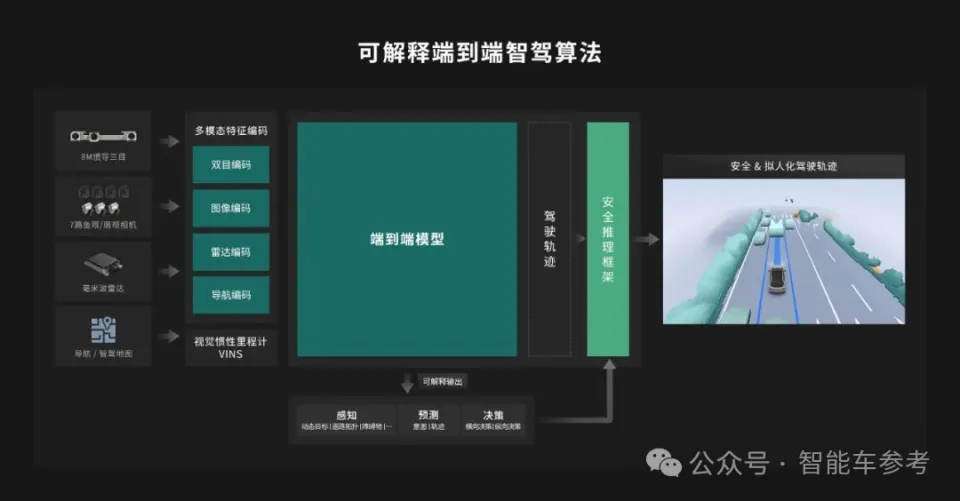

红旗进一步透露,今年年底还将上车一段式端到端,减少模型内部信息传递损失,让车的反应更快。

并且强调了模型可解释,以及安全兜底措施。

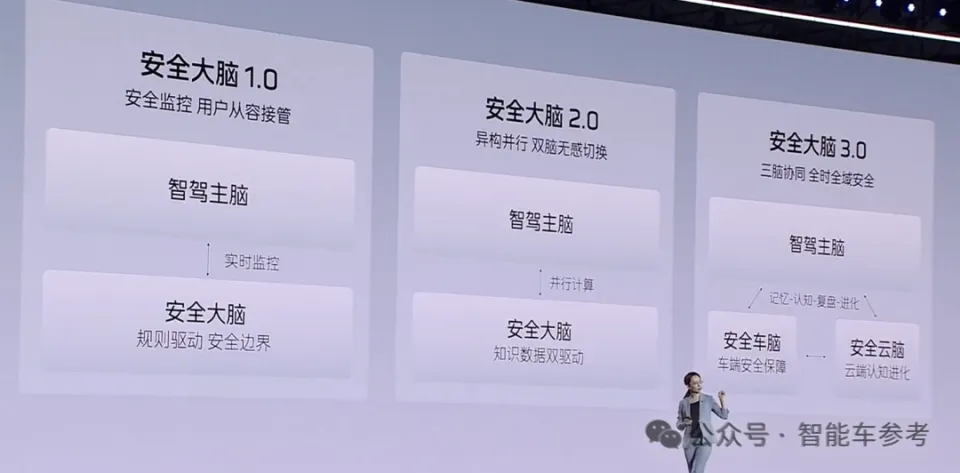

与此同时还预告了VLA模型进展(视觉-语言-动作模型),包括智驾主脑和安全大脑,智驾主脑是AI模型,安全大脑则是规则控制,负责在必要时接管智驾主脑。

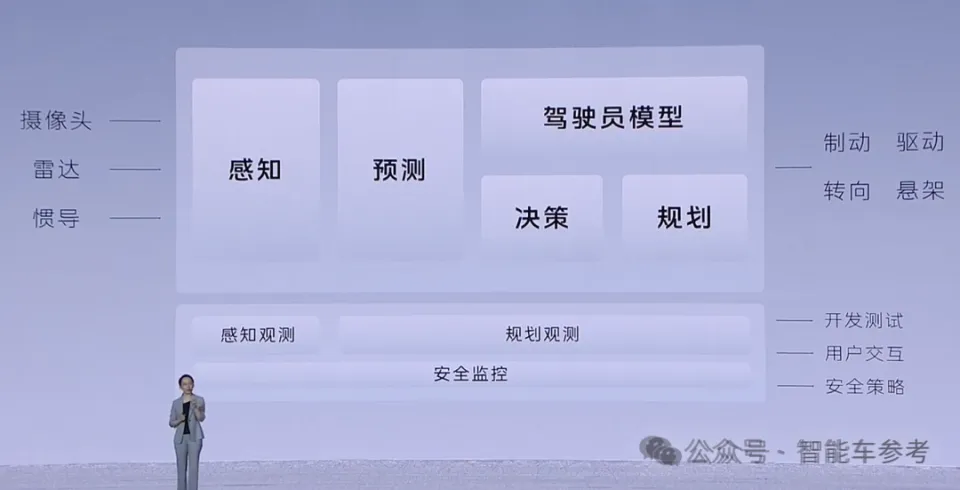

总结一下,红旗最新智驾技术体系,基本模式和主流玩家相同,都是一个大模型+一个小模型。

其中小模型是搭载在车上的端到端模型,负责执行主要的智能驾驶任务。当然这里的“小”是相对而言。

比车端模型规模更大是VLA,以大语言模型为基础,作为端到端模型的补充和兜底,基本思路是利用语言模型的认知能力,充当端到端模型的“点读机”,单独输出一条行车轨迹供车端参考校验。

这其中VLA大模型还在研发中,最快上车量产的是车侧智驾模型。

也就是行业共识每年“万卡+十亿”投入才玩的转的端到端自动驾驶技术。

所以,除了10年前就押注投入的个别新势力以外,和自动驾驶供应商合作,成了所有老牌主机厂抓住智驾普及浪潮的唯一方法。

一汽红旗,选择了大疆。

大疆提供了什么样的技术

先科普一下,大疆自动驾驶业务2023年从集团独立,成立的新公司叫卓驭科技,背后大疆仍是卓驭科技的股东。

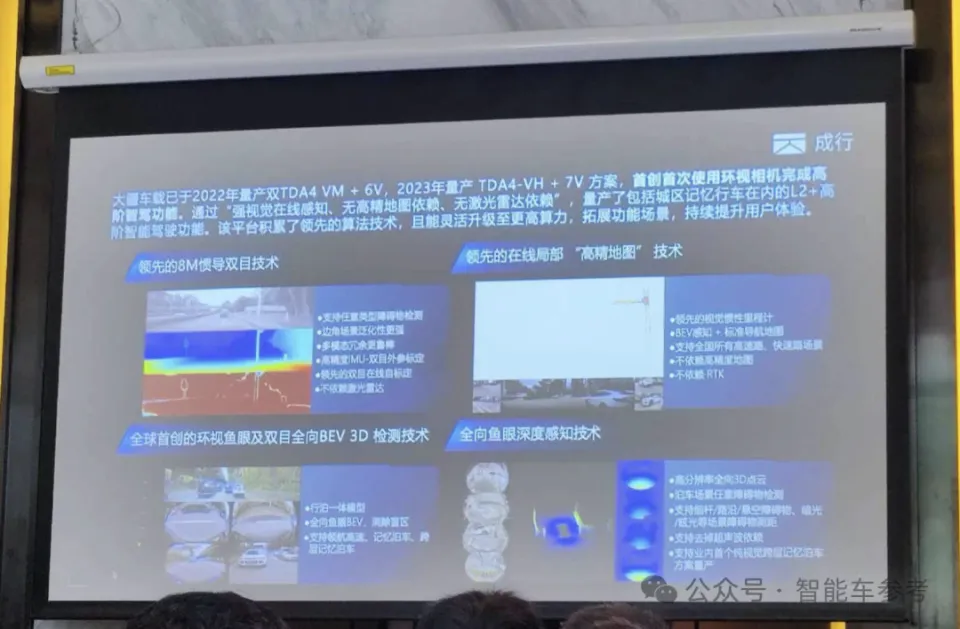

作为供应商叫“卓驭”,而在内部技术体系被称作“成行平台”,有带“舱内”激光雷达的激目方案,也有纯视觉的方案。

卓驭官方透露,红旗“司南智驾”的基础,正是成行平台“7V 100T”方案。

特点是在极致算力压榨下高效部署模型的能力,通过一个模型打通感知、预测、决策和规划多个模块,让智能驾驶系统信息传递损失更少,性能体验上限更高。与此同时,在端到端模型内保留感知、预测、决策模块中间的可解释输出,以提供丰富的语义交互信息,让用户在智驾的体验过程中理解更直观、使用更安心。

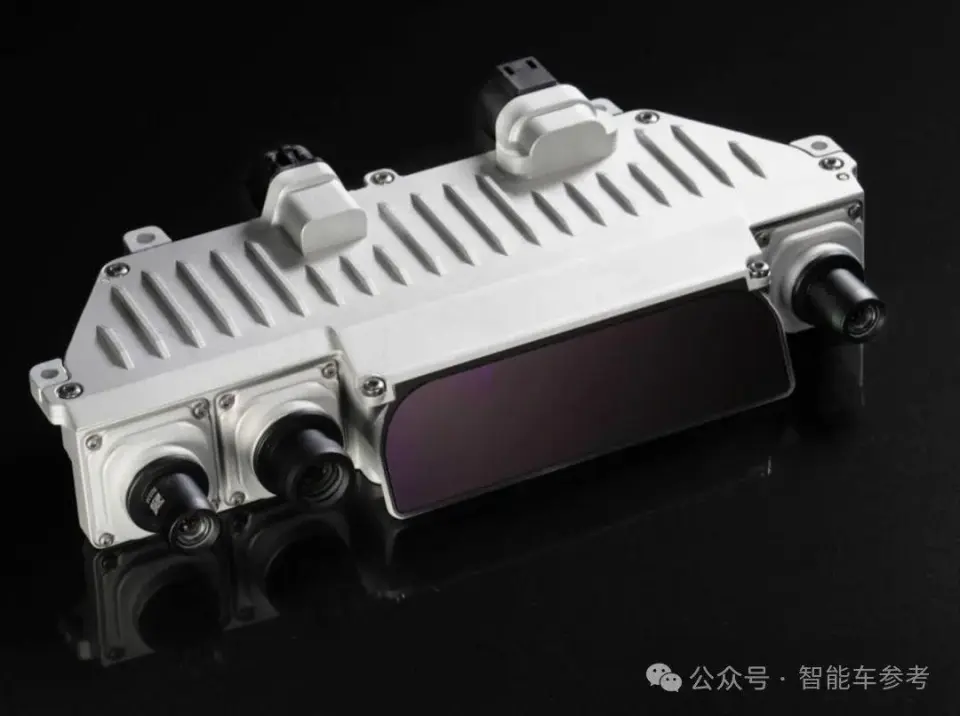

具体配置上,“7V”指的系统有一套前视8M的惯导双目(两颗摄像头),加4颗环视鱼眼摄像头以及后视单目,一共“2+4+1”7颗摄像头。另外毫米波雷达、超声波雷达都可以选装。

为什么是7V?大疆表示是在过去几年积累当中总结出来的能够平衡性能和成本的智驾最优解。价格仅相当于主流融合感知方案的几分之一甚至十几分之一,而且可以近乎实现100%同样的功能,在正常场景绝大部分的Case下的鲁棒性也非常强。

从感知范围上来看,鱼眼+双目的方案能够实现全向BEV的3D感知。前视双目,类似于人的眼睛,双目能够直接感知到障碍物的深度,而且有更强的边角场景的泛化能力。

对领航辅助驾驶里的主动变道,则是通过鱼眼来实现。大疆车载是全球首创用鱼眼来做高阶智驾功能的供应商。

当然,要让“简陋”的硬件发挥出“堆料豪华版”的智驾能力,对软件的要求成倍提高。

首先7V100T的基础,是高通8650平台,能够跑Transformer,可以有更多计算资源做卷积网络以及BEV的感知。

Transformer架构使得算法能够通知识别路上的目标、车道线、道路拓扑结构,以及输出生成OCC占用网络结果。

OCC我们科普过很多次,意思是把环境进行“体素化”,变成乐高 一样的方块,只需要知道方块是否被“占用”,而根本不必识别是什么物体,提早做防御性、减速的行为。

道路拓扑感知也是一个关键。传统意义上,高精度地图的主要作用就是告诉系统道路的连接关系。

如果没有高精度地图的实时感知,往往需要手写大量规则,泛化性不强,而且需要结合不同地区、城市的规则。

大疆基于RS-Net能够使用大量的数据训练模型,即便没有来过也知道这个路网大概长什么样,有助于下游规控更好的做变道的决策,包括左右以及绕行的决策。

总结一下,只需要标准的导航地图,结合在线感知,就能够模拟人类司机推理它的道路结构。因此不存在开城的说法,毕竟场景可以直接泛化。

大疆望通过强视觉在线感知,减少对高精度地图和激光雷达的依赖,量产包括城区记忆领航在内L2+高阶智驾功能。

实际上,大疆强视觉感知算法,是整个成行平台技术的核心。

即使是带激光雷达的“激目”方案,其中Lidar的作用也仅仅是对感知数据补充冗余,对分辨率、探测距离的要求远低于常规融合感知方案,大大降低了量产上车的成本门槛。

几乎所有智驾供应商都在谈极致性价比,大疆却是唯一一个解释清楚如何用算法能力补足激光雷达缺失的玩家。

大疆卓驭,祛魅高阶智驾

红旗赢了,轰轰烈烈的智能车浪潮中一改低调,一夜跻身第一梯队。

大疆也收获颇丰,五菱的A0级小车之外,首次在主流自主乘用车上证明实力,而且是“一哥”红旗,样板间作用难以忽视。

不过在技术层面多思考一步,大疆上车红旗,代表了自动驾驶发展的一股趋势。

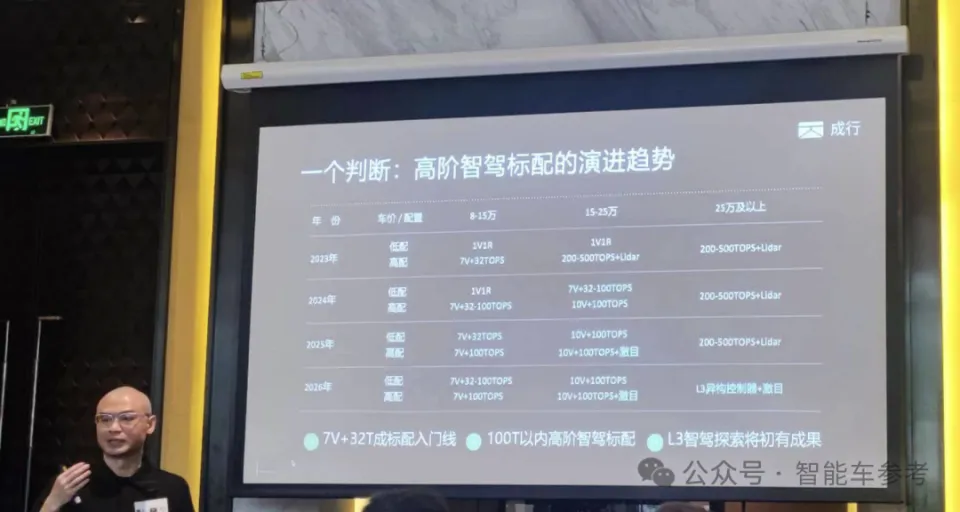

去年量产智驾进入爆发期,逐渐以“成本”为尺度,划分出了“入门”和“高阶”功能的格局。

20万以下是入门智驾,没激光雷达,功能只到高速NOA;20万以上给高端智驾,搭载激光雷达,功能拓展到城市NOA。

中高端车型+Lidar的高阶智驾叙事方式,垄断了用户心智。

但大疆从技术层面给出了“不唯传感器论”的依据。

比如舱内激光雷达方案,订制玻璃可以做,普通的前挡玻璃也能做。对透光条件没有什么特殊要求。另外,激光雷达分辨率低一点也没关系,不影响系统的功能和体验。

大疆从来不追求某一单一传感器性能的绝对领先,也不是简单的“反激光雷达”,甚至大疆本身也在研发融合方案,但是系统整体的可靠安全性基础,仍然是大疆的纯视觉软件算法能力

比如8650平台上基于Transformer预测和决策联合模型。

输出两个东西:1)其他车辆预测轨迹;2)本身决策的分布。

有两个好处:

1)同时左转的博弈场景,传统的方法不太好判断边上旁车到底是加塞还是临停,有了这个NN模型预测和决策的网络,可以减少误刹车的概率。

2)做城区绕行决策时,能够准确输出绕行的时间。比如路边的临停车辆,传统的决策系统要知道这是一个什么场景,以及这是不是一个临停车辆才能做一个绕行决策,但有了NN Decision网络后,能够发起绕行,同时增强绕行决策的准确率。

类似这样的技术方案还有很多,大疆将它们逐渐量产,实现对高阶智驾的“祛魅”:

不是被迫以成本划分方案,而是从技术角度出发,让激光雷达回归“辅助”、“冗余”的定位位,由此实现高阶智驾的大规模普及。

不过尽管红旗是大疆落地得一个重要客户,但对于大疆而言同样存在挑战。

之前华为从高端、从激光雷达往纯视觉打,大疆从大众车型、从视觉往激光雷达打……

与华为在智选车、Hi模式下都斩获颇多领先第一梯队相比,大疆车载、卓驭还在等待主机厂的爆款和样板间。

—联系作者—

— 完 —

「智能车2024年度评选」征集中!

智能车参考作为以智能维度关注汽车产业的内容平台,作为智能车领域最具影响力的社区,每年以年度盘点和评选的方式,为从业者及广大读者提供参考和注脚。

欢迎扫码报名!共同见证2024智能车新的浪潮之巅。

本次评选的截止时间为:2024年12月20日

—完—

【智能车参考】原创内容,未经账号授权,禁止随意转载。

上一篇

上一篇